Niantic将《精灵宝可梦 Go》的AR数据变成送货机器人的“活地图”

Niantic 正在把曾经让皮卡丘稳稳站在现实世界人行道上的那套全球 AR 技术,转而用来指挥更接地气的主角——在人行道上穿梭、寻找正确门牌号的送货机器人。 通过多年积累的定位数据和街景图像,这家公司如今为 Coco Robotics 等企业提供厘米级精度的视觉定位服务,专门解决传统 GPS 在高楼林立城市中“迷路”的老问题。

Niantic Spatial 是 Niantic 于 2025 年孵化的一家 AI 分拆公司,专门将多年的移动游戏数据提炼为高精度的现实世界“世界模型”。 官方形容,这是一套仅依靠摄像头画面和地图上下文,就能在厘米级范围内为设备确定位置和姿态的视觉定位系统(VPS),并通过商业化接口对外提供服务。 其首个大规模商用合作伙伴,是在欧美多座城市运营约一千台人行道机器人的末端配送公司 Coco Robotics,当地的卫星信号往往嘈杂到难以支撑可靠的自动驾驶。

Niantic Spatial 要解决的技术难题并不难以描述,却非常难以真正攻克:在高密度城市环境中,GPS 信号在玻璃幕墙和混凝土之间反射,定位误差动辄达到数十米。 对于一台送货机器人而言,这种偏差足以让它跑到错误街区,甚至街道的另一侧。 Coco 的机器人巡航速度约每小时五英里,可一次运送多份超大号披萨或几袋杂货,如果想要在准时率和取送精度上不输人类骑手,就必须依靠更稳定、更精细的导航能力。

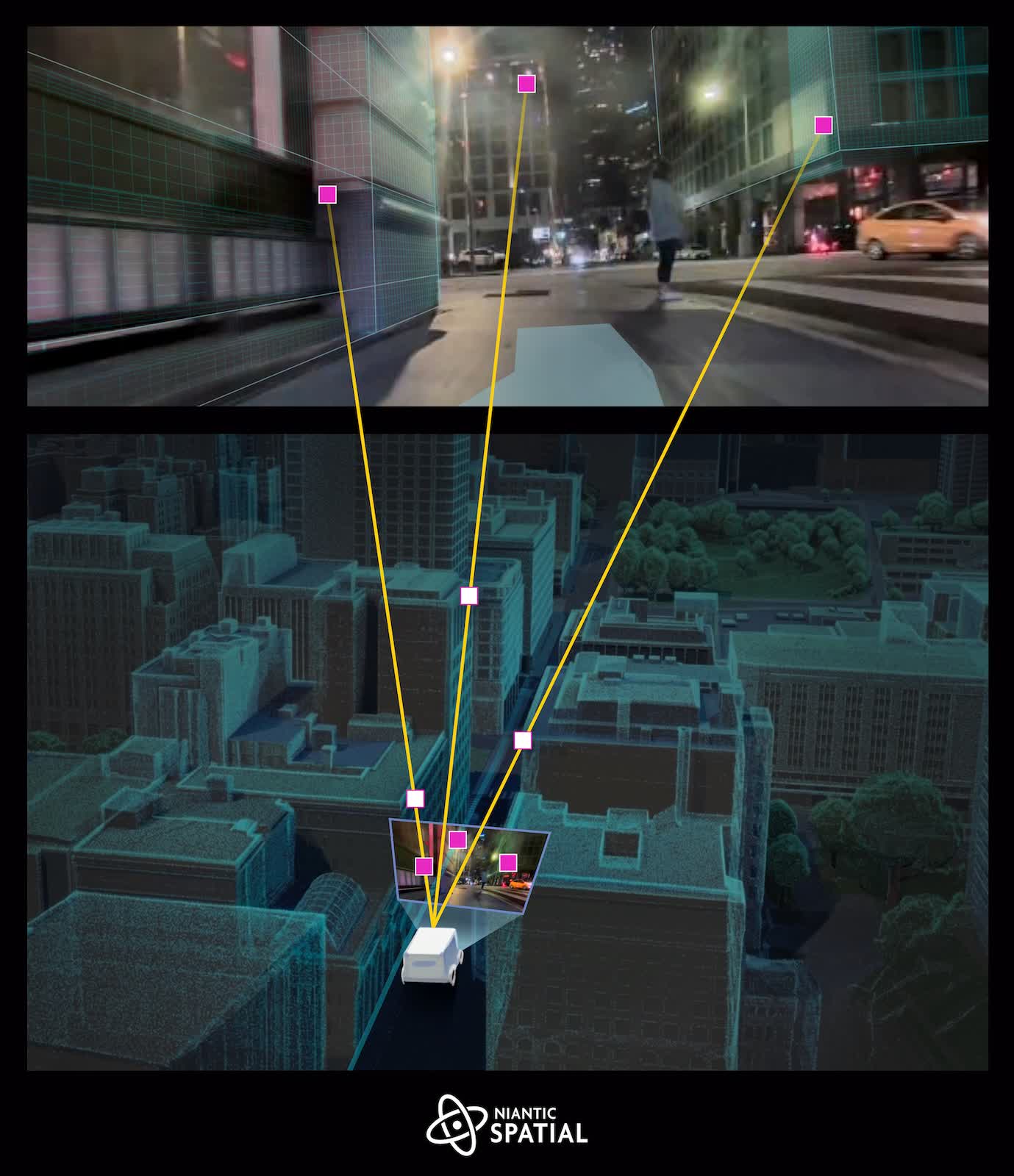

Niantic Spatial 的替代方案,是依赖“所见”而非无线电信号的视觉定位系统。 多年来,公司持续汇聚来自《精灵宝可梦 Go》和其更早的增强现实游戏《Ingress》的数据,这两款游戏都鼓励玩家前往现实世界中的 gym、战斗场和各类兴趣点打卡。 这种游戏机制无形中构建了一套密集的全球城市数据集:玩家在城市环境中拍下的海量图像,与手机记录的经纬度、摄像头朝向、设备姿态、运动状态以及其他传感器数据精确绑定。

据 Niantic Spatial 介绍,其模型训练数据包含约 300 亿张图像,围绕逾一百万个“热点”地点高度聚集,这些地点从不同角度、在一天中的不同时段以及各种天气条件下被反复拍摄。 由于每一帧画面都对应厘米级的姿态估计,这套训练集本质上构成了一种多视角的 3D 采样,覆盖城市街道、人行横道、店面门头以及建筑立面。 在此基础上,模型可以通过少量实时拍摄的图像推断出精准的位置和朝向,即便是在原始数据覆盖不如这些热点密集的区域也同样适用。

对 Coco 来说,这意味着其机器人可以将 GPS 信号与 Niantic Spatial 提供的相机定位结果进行融合。 每台机器人配备四枚安装在“臀部高度”的摄像头,从四个方向环绕拍摄,这种视角和人类用手机举在手里拍摄有所不同,但 Coco 表示,将这类数据适配进现有模型相对直观。 目前,这些机器人已经在洛杉矶、芝加哥、迈阿密、泽西市和赫尔辛基等地完成了数十万单配送、累计行驶超过一百万英里,为公司提供了评估新系统可靠性提升幅度的参照基线。

视觉定位本身并非全新概念,但长期以来受制于高质量图像的采集密度和覆盖范围。 Niantic Spatial 押注的是,其依托众包游戏数据形成的数据体量与多样性,将优于那些主要依靠自有传感器车队采集地图的竞争对手。 一些其他送货机器人厂商(例如 Starship Technologies),通常通过自身传感器在运行路径上构建局部 3D 地图,记录路缘、路牌、建筑轮廓等,然后在后续行程中反复利用这些地图。 相比之下,Niantic Spatial 希望维护的是一套全球共享的地理空间模型,并通过 API 对任何需要精确定位的机器人、手机或头显开放。

Niantic 将这套模型称为“活地图”:一份随时随传感器更新的世界虚拟表征。 随着 Coco 的机器人以及未来更多合作伙伴在街道和人行道上穿行,它们的传感器会持续回传新的观测数据,用于修正并扩展 Niantic Spatial 底层地图。 目标不只是几何精度,还包括语义理解——在地图中以机器可理解的方式标注和描述各类对象。

Niantic 高层将这项工作视作数字地图长期演进的一部分,而非彻底的路线转向。 从 2D 地图到 3D,再到如今趋向动态“数字孪生”的模拟世界,地图坐标与物理空间的核心关联始终未变。 真正发生变化的是这类地图的“主要消费者”:从过去以人为主,正逐步转向以机器为主。 在这样的视角下,当年用来保证虚拟皮卡丘牢牢站在人行道上的空间智能,如今正被移植到一台重达百磅、需要在风雨和车流中保持航线稳定的送货机器人身上。